В Google DeepMind представили концепцию переработанного указателя мыши, который объединяет привычный курсор с возможностями ИИ. Основная идея — избавить пользователя от необходимости формулировать сложные текстовые запросы и перемещаться между окнами, заставив саму систему считывать контекст того, что находится под курсором. Авторы проекта опубликовали в блоге компании описание четырёх принципов, на которых строится новая механика взаимодействия. Они отмечают, что за полвека курсор практически не изменился, хотя сами компьютеры пережили несколько технологических волн.

Сегодня большинство ИИ-сервисов живут в отдельных вкладках или приложениях и чтобы получить помощь, нужно сначала описать задачу словами, а часто ещё и вручную перенести контекст — скопировать текст, прикрепить файл, сделать скриншот. В DeepMind предлагают обратную логику: ИИ должен сам «приходить» к пользователю туда, где тот работает, и понимать, что ему нужно, на основе положения курсора и минимальных подсказок. Экспериментальная система на базе Gemini фиксирует не просто координаты, а сам объект под указателем — будь то слово, блок текста, изображение, дата или элемент интерфейса. После этого достаточно короткой голосовой или текстовой команды. Например, можно навести курсор на фотографию здания и сказать «построй маршрут» — ИИ сам определит адрес, не требуя дополнительных пояснений. Или выделить рецепт и попросить «удвой ингредиенты», навести на таблицу с цифрами и запросить «сделай круговую диаграмму», указать на PDF и сказать «перескажи кратко».

Разработчики назвали четыре ключевых принципа такой механики:

- ИИ-функции доступны везде, где находится пользователь, без переключения в отдельные окна и сервисы.

- Модель захватывает визуальный и семантический контекст под курсором, понимая, какая именно часть экрана важна, без многословных описаний.

- Естественная для человека манера общения с помощью жестов и коротких фраз заменяет длинные промпты.

- Раньше компьютер лишь отслеживал место клика. Теперь он способен распознать, что именно находится под указателем, и превратить это в интерактивный элемент — дату для календаря, адрес для карт, строку кода для редактора, рукописную заметку в список задач.

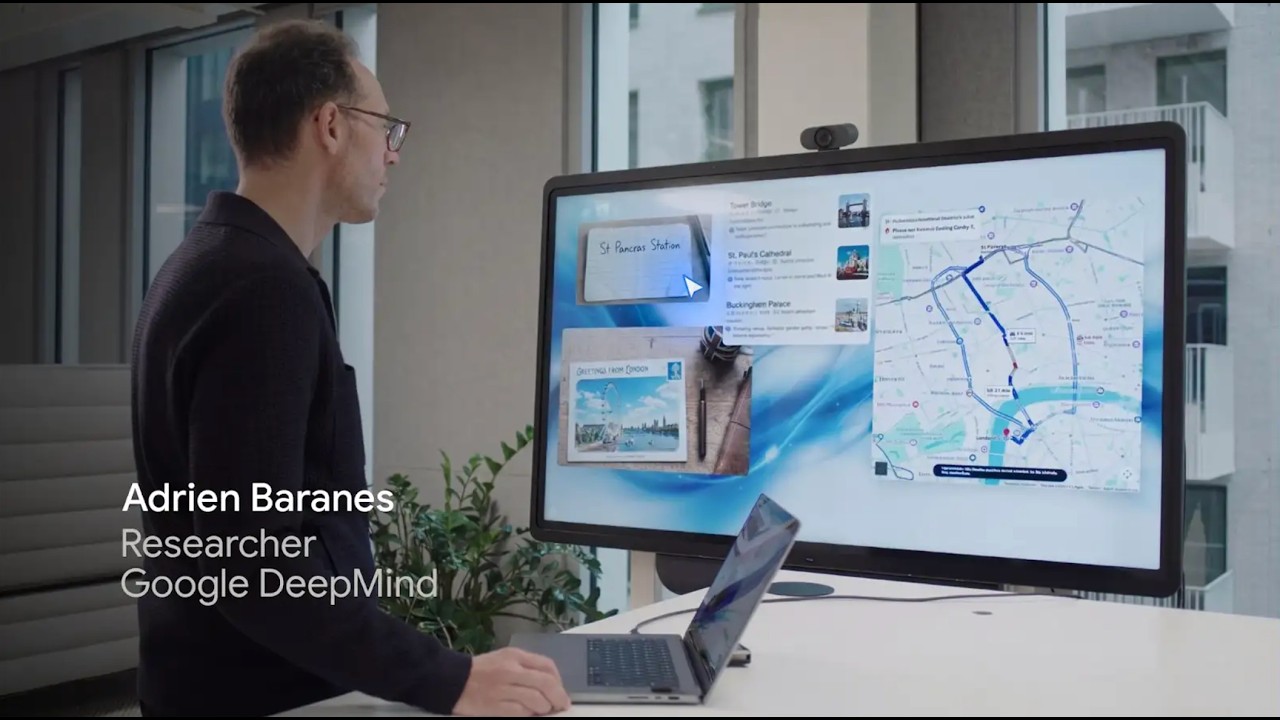

В видеодемонстрации, опубликованные командой DeepMind, показывают работу прототипа в экспериментальной среде. Курсор визуально меняет форму, сигнализируя, что система распознала объект и готова принять команду. Далее достаточно произнести короткую фразу или выбрать действие и Gemini выполняет задачу прямо в том же окне. Часть этой концепции уже реализована в актуальных продуктах Google. В браузере Chrome пользователи могут задать вопрос о конкретном фрагменте веб-страницы, просто выделив его курсором и обратиться к Gemini. В скором времени похожая функция появится на ноутбуках Googlebook под названием Magic Pointer.

Пример работы «умного» курсора

По замыслу исследователей, технология должна адаптироваться к человеческому поведению, а не заставлять людей осваивать новые интерфейсы. Отказ от громоздких текстовых инструкций в пользу показа и коротких реплик может сократить порог входа для пользователей, которые пока не привыкли взаимодействовать с нейросетями.

Как вы считаете, сделает ли подобный способ управления ИИ работу за компьютером действительно проще или голосовые команды и постоянное отслеживание курсора создадут лишний дискомфорт в повседневных задачах? Делитесь в комментариях.

PC НовостиЖелезо и технологииGoogleискусственный интеллект

Источник: vgtimes.ru