Ant Group представила LLM-модель Ling-2.6-flash, входящую в семейство крупных языковых моделей. За сухими цифрами в 104 миллиарда параметров (из которых активны только 7,4 миллиарда) скрывается довольно любопытная инженерная история.

За несколько дней до официального анонса модель уже курсировала по OpenRouter под псевдонимом Elephant Alpha. И там она не просто присутствовала, а несколько дней подряд удерживала первую строчку трендового чарта. Разработчики, тестировавшие анонимную версию, заметили необычно высокую отзывчивость при низком потреблении токенов. Ежедневный объём обращений к ней достигал 100 миллиардов токенов — показатель, который многие состоявшиеся модели собирают за недели.

Ant Group делает ставку не на размер модели, а на эффективность. Активная часть в 7,4 миллиарда параметров позволяет Ling-2.6-flash выдавать 340 токенов в секунду при реальных замерах. Для сравнения, это значит, что длинный отчёт или глава книги обрабатываются почти мгновенно.

Но ещё интереснее экономия токенов. Производитель заявляет, что новая модель расходует примерно одну десятую часть токенов по сравнению с аналогами той же весовой категории. Другими словами, один и тот же результат достигается при значительно меньшем объёме входных данных. Для команд, которые каждый месяц платят за миллионы токенов, это выглядит как прямое снижение операционных расходов.

Модель позиционируют как специально адаптированную для агентных сценариев. То есть, это не просто генератор текста, а более предсказуемый исполнитель целых цепочек действий. Высокая скорость вывода и низкое потребление токенов здесь критичны, потому что ИИ-агенты обычно делают множество последовательных вызовов.

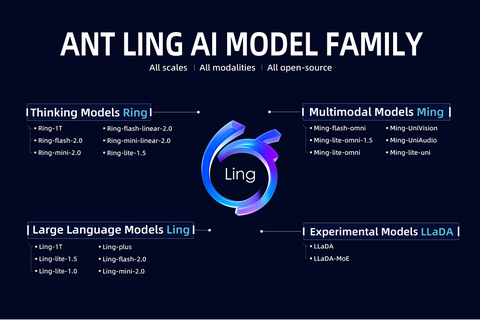

Ling-2.6-flash — лишь один из представителей более крупной экосистемы. Сама Ant Group разрабатывает семейство Ant Ling AI Model Family, цель которого — продвигать надёжный искусственный интеллект и его приложения в реальных отраслях: здравоохранении, финансовых услугах и повседневных сервисах.

Внутри семейства существуют три основные линейки. Серия Ling — это классические большие языковые модели. Серия Ring отвечает за модели рассуждений. А серия Ming занимается мультимодальными задачами. Вместе они покрывают спектр от 16 миллиардов до 1 триллиона параметров.

Ling — это стандартная языковая модель без механизма рассуждений, и её характеристики сопоставимы с лучшими закрытыми моделями индустрии.

Модель рассуждений Ring внедрила собственный алгоритм Icepop, который решает проблему несоответствия между обучением и логическим выводом. Благодаря этому математические способности Ring достигли уровня серебряного призёра Международной математической олимпиады. Для инженерной среды это серьёзная заявка.

Мультимодальная Ming обрабатывает текст, изображения, аудио и видео, а генерировать может текст, изображения и звук. Она стала первой открытой моделью, которая сравнялась с GPT-4o по широте поддерживаемых модальностей, имея явные технические преимущества в унифицированном понимании и кросc-модальном синтезе.

Внутри самой Ant Group, модели семейства уже работают над созданием повседневных сервисов для учета финансов и личного здоровья. На их основе созданы интеллектуальные приложения: AI-ассистент по здоровью AQ, финансовый менеджер и помощник по образу жизни. Сквозная видимость запасов. Почему цифры сходятся, а товара на полке нет Олег Бунин: «Для меня промышленный ИИ — это ИИ, обладающий пространственным мышлением» Евгения Шенкао: «Купить технологию — не проблема. Проблема — начать с ней жить»

Отдельного внимания заслуживает безопасность. Семейство Ant Ling выстроило прочный фундамент в области робастности, создав объединённые механизмы обнаружения и защиты. Единая платформа безопасности Ant AI Security Detection Platform предлагает полноценный сервис для больших моделей на всём жизненном цикле — от разработки до развёртывания. Кстати, планируется, что Ling-2.6-flash получит и открытые версии в форматах BF16, FP8 и INT4.

Итак, новая модель с заявленными 104 миллиардами параметров называет себя быстрой и экономной, и факты говорят сами за себя: десятикратная экономия токенов, триллионные «соседи» по семейству и полностью открытая экосистема. Ant Group, похоже, действительно старается сделать так, чтобы AI работал для каждого. И пока это у них получается без лишнего пафоса.

Источник: www.it-world.ru