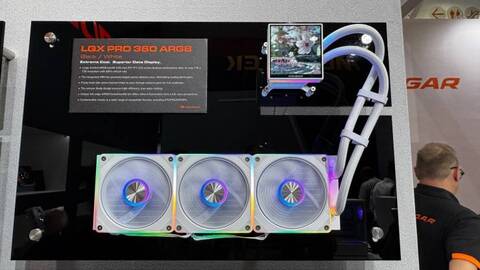

DeepCool обновила линейки корпусных вентиляторов на Computex 2026

На выставке Computex 2026 DeepCool обновила ассортимент корпусных вентиляторов для тихих систем с минимальным количеством кабелей. Серию FL12 с последовательным подключением дополнили модели FL12 INF, получившие боковые ARGB-зеркала с эффектом бесконечности. Они будут доступны в черном и белом цветах, а также с классическим или реверсивным направлением лопастей. Бюджетные линейки заменили на FD12 V2 и FD12