По сообщению Bloomberg, компании OpenAI, Anthropic и Google начали совместную работу по пресечению несанкционированного копирования своих передовых моделей китайскими конкурентами. Компании обмениваются данными через некоммерческую организацию Frontier Model Forum, созданную в 2023 году при участии Microsoft, чтобы выявлять попытки так называемой «враждебной дистилляции», нарушающей условия использования фирменных продуктов.

В основе претензий технологических гигантов лежит процесс, который подразумевает использование сложной оригинальной «модели-учителя» для тренировки более дешевой «модели-ученика», которая в итоге воспроизводит возможности старшей ИИ-модели. Эта стратегия позволяет иностранным конкурентам избегать огромных затрат на разработку ИИ с нуля и выпускать алгоритмы, лишенные встроенных механизмов безопасности (например, блокировок на создание биологического оружия).

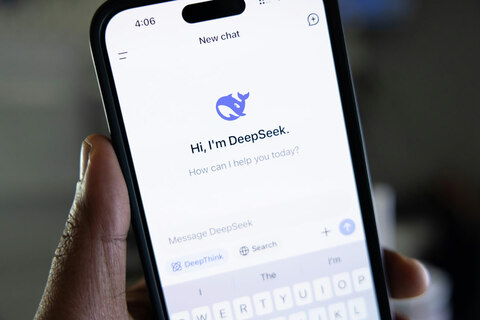

Особое внимание к проблеме привлёк январский релиз мощной «рассуждающей» модели R1 от китайского стартапа DeepSeek, которого компания OpenAI прямо обвинила в попытке незаконно использовать американские инновации. Ранее аналогичные обвинения от лаборатории Anthropic получили азиатские проекты Moonshot и MiniMax. Для противодействия этой практике администрация президента Дональда Трампа даже предложила создать специальный центр по обмену данными по аналогии со сферой кибербезопасности. Однако на данный момент масштаб сотрудничества между ИИ-компаниями остаётся ограниченным из-за опасений нарушить текущее антимонопольное законодательство США.

Как отмечает Bloomberg, объединение между названными американскими компаниями, являющимися друг для друга прямыми конкурентами, отражает серьёзность угрозы, так как незаконное извлечение результатов, заложенных в ИИ-модели наносит ущерб в миллиарды долларов ежегодно и создаёт риски для национальной безопасности.

Источник: mobile-review.com