Исследователи из Google нашли способ хранить данные внутри языковой модели в шесть раз компактнее.

Внутри каждой языковой модели есть что-то вроде блокнота для заметок. Он называется KV-кэш: туда записываются промежуточные вычисления, чтобы модель не пересчитывала одно и то же заново. Чем длиннее контекст разговора, тем толще этот блокнот, и тем дороже память на серверах. И именно здесь давно существует узкое место, которое тормозит и удорожает работу ИИ в промышленных масштабах.

Google Research предложила три взаимосвязанных алгоритма, которые атакуют эту проблему с разных сторон. Главный из них — TurboQuant, который будет представлен на конференции ICLR 2026.

Суть метода заключается в том, что данные в кэше хранятся в виде числовых векторов, длинных списков чисел с дробной точностью. Стандартные методы квантования заменяют точные числа грубыми приближениями, но тогда теряется точность. Плюс почти все существующие подходы вынуждены хранить дополнительные «поправочные коэффициенты» — это съедает лишний бит-полтора на каждое число и частично обнуляет выигрыш от сжатия.

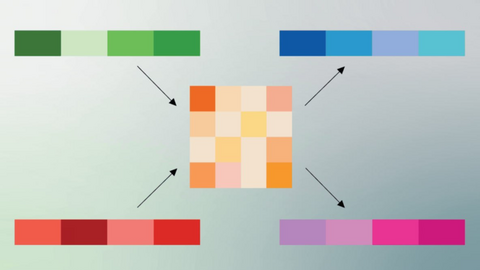

TurboQuant обходит эту ловушку через два шага. Сначала он случайным образом «поворачивает» вектор в математическом пространстве — это делает распределение чисел более равномерным и предсказуемым. Дальше в дело вступает алгоритм PolarQuant: вместо привычных декартовых координат он переводит каждую пару чисел в полярные — радиус и угол. Например, если бы люди вместо «три шага на восток и четыре на север» говорили «пять шагов под углом 37 градусов». Угловая сетка фиксирована, границы известны заранее, и никакой дополнительной нормировки не нужно. Накладные расходы на хранение метаданных исчезают.

Источник: hi-tech.mail.ru