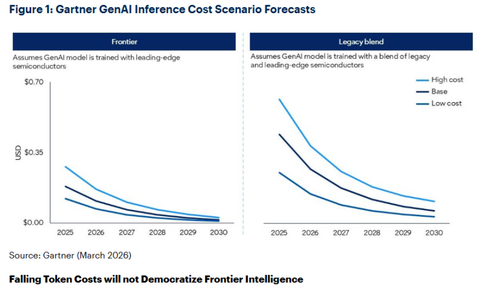

Согласно прогнозу Gartner, к 2030 году инференс LLM с триллионом параметров будет обходиться провайдерам ИИ-сервисов более чем на 90 % дешевле в сравнении с 2025 годом. При этом речь не идёт о получении всеобщего доступа к передовым вычислениям.

В Gartner для исследования каждый токен «оценили» в 3,5 байта или приблизительно четыре символа английского текста. Эксперты предполагают, что снижение затрат будет обусловлено сочетанием повышенной эффективности ИИ-чипов и сопутствующей инфраструктуры, инновациями в разработке самих моделей, повышением эффективности использования чипов, расширением использования специализированных инференс-ускорителей, а также распространением периферийных вычислений для определённых сценариев.

В результате, по прогнозам Gartner, к 2030 году LLM станут в 100 раз более экономически эффективными в сравнении с первыми моделями аналогичного масштаба, представленными в 2022 году. Согласно выкладкам Gartner, эксплуатировать модели с помощью передовых ИИ-чипов будет предсказуемо значительно дешевле, чем с использованием более старого или смешанного оборудования на основе более доступных полупроводников с учётом меньшей вычислительной мощности. Про это, в частности, регулярно говорит NVIDIA.

Источник изображения: Gartner

Впрочем, снижение стоимости токенов вовсе не означает, что передовые технологии станут более доступными для всех. Во-первых, снижение себестоимости для ИИ-провайдеров не будет означать соизмеримого падения цен для корпоративных клиентов. Кроме того, передовым ИИ-технологиям нужно будет значительно больше токенов, чем сегодня. Так, ИИ-агенты требуют на задачу в 5–30 раз больше токенов, чем обычный чат-бот, и способны выполнять значительно больше задач, чем обычный человек, использующий ИИ.

Хотя возможности ИИ расширятся, это будет сопровождаться «непропорционально большим» ростом спроса на токены. Их потребление растёт быстрее, чем снижается стоимость, поэтому ожидается увеличение затрат на инференс. Подчёркивается, что речь не идёт о демократизации передовых вычислений. Стоимость «стандартного» ИИ действительно продолжит падать, но ресурсы, необходимые для сложных ИИ-проектов, по-прежнему будут в дефиците. Руководителям ИИ-проектов, пока маскирующим недостатки их архитектур дешевеющими токенами, придётся столкнуться с трудностями при масштабировании вычислений, связанных с ИИ-агентами.

По прогнозам Gartner, наиболее востребованными станут платформы, позволяющие координировать рабочие нагрузки, распределяемые в рамках целого портфеля моделей. Так, рутинные задачи необходимо поручать небольшим, специализированным ИИ-моделям, лучше подходящим при меньших затратах для специальных рабочих процессов в сравнении с универсальными решениями. А дорогостоящие ресурсы передовых моделей необходимо выделять со строгими ограничениями, резервируя их только для сложного, но высокомаржинального инференса.

Источник: servernews.ru