Компания DeepSeek официально выпустила две новые большие языковые модели: DeepSeek-V3.2 и DeepSeek-V3.2-Speciale. Обновление до полной версии DeepSeek-V3.2 уже доступно на официальном сайте, в приложении и через API. Модель V3.2-Speciale пока предоставляется как временный API-сервис для исследовательских целей.

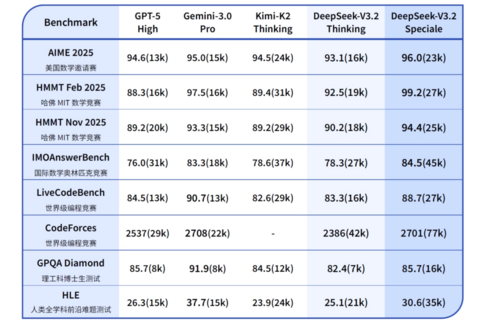

Модель DeepSeek-V3.2 создана для баланса возможностей вывода и длины ответа, что делает её подходящей для повседневных задач, включая вопросы-ответы и общие функции агента. В тестах производительности вывода V3.2 демонстрирует уровень, сравнимый с GPT-5, и лишь незначительно уступает Gemini-3.0-Pro, при этом существенно сокращая длину выходных данных по сравнению с Kimi-K2-Thinking, что снижает вычислительные затраты и время ожидания.

DeepSeek-V3.2-Speciale является улучшенной версией V3.2, включающей возможности длительного мышления и доказательства теорем из DeepSeek-Math-V2. Эта модель отличается улучшенными способностями в логическом выводе, математических доказательствах и следовании инструкциям, достигая производительности, сопоставимой с Gemini-3.0-Pro в тестах логического вывода. V3.2-Speciale успешно завоевала золотые медали на олимпиадах по математике и программированию IMO 2025, CMO 2025, ICPC World Finals 2025 и IOI 2025.

Источник: mobile-review.com