OpenAI представили GPT-5.1-Codex-Max. Модель обучали на реальных инженерных задачах — от создания PR до отладки и фронтенда. Она доступна в Codex в CLI, IDE и Cloud, а API готовят к запуску.

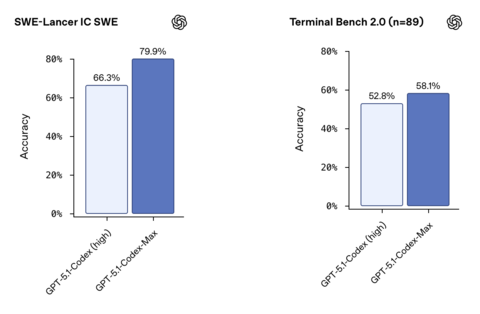

Модель показывает рост точности. На SWE-Lancer результат вырос с 66.3% до 79.9%. На SWE-Bench Verified — с 73.7% до 77.9% при более экономном использовании thinking-токенов. Для сравнения: при среднем уровне рассуждений она тратит примерно на треть меньше токенов, чем предыдущая версия. По заверениям OpenAI на длинных сессиях модель способна работать более 24 часов, последовательно фиксируя тесты и дорабатывая код.

Напомню, что текущим лидером по SWE-Bench был Sonnet 4.5 от Claude со значением 77.2%. Теперь первую строчку будет занимать GPT-5.1-Codex-Max.

GPT-5.1-Codex-Max рассчитана на длительную и детализированную работу. Это наша первая модель, которая изначально обучена работать через несколько контекстных окон благодаря процессу, который называется компакцией: она последовательно и согласованно оперирует миллионами токенов в рамках одной задачи. Это открывает возможности для рефакторинга уровня всего проекта, глубоких сессий отладки и многочасовых агентных циклов.

GPT-5.1-Codex-Max стал заметно эффективнее в расходовании токенов благодаря улучшенным механизмам рассуждения. На SWE-Bench Verified GPT-5.1-Codex-Max с уровнем рассуждения medium показывает лучшие результаты, чем GPT-5.1-Codex при тех же условиях, используя при этом на 30% меньше thinking-токенов.

Для задач, где задержка не критична, OpenAI добавили новый режим рассуждения — Extra High (xhigh): он думает дольше и выдаёт более качественный результат. Тем не менее, в большинстве случаев мы рекомендуем режим medium как основной.

Благодаря этому нововведению ожидается улучшение в эффективности потребления токенов и, как следствие, реальной экономии для разработчиков.

Длительные задачи

Компакция позволяет GPT-5.1-Codex-Max завершать задачи, которые раньше невозможно было выполнить из-за ограничений контекстного окна: сложные рефакторинги, долгие агентные циклы — модель отбрасывает менее важную историю, сохраняя ключевой контекст на долгой дистанции.

В Codex GPT-5.1-Codex-Max автоматически выполняет компакцию сессии при приближении к пределу контекстного окна, освобождая пространство и продолжая работу без потери прогресса. Этот процесс повторяется до завершения задачи.

Возможность удерживать целостность работы на длинной дистанции — основа пути к более универсальным и надёжным ИИ-системам. GPT-5.1-Codex-Max может работать автономно часами. В наших внутренних тестах мы наблюдали, как модель работает над задачей более 24 часов подряд — непрерывно повторяя итерации, исправляя тесты и в итоге выдавая корректный результат.

В этом примере GPT-5.1-Codex-Max самостоятельно рефакторит Open source-репозиторий Codex CLI.По мере заполнения контекстного окна модель автоматически проводит компакцию, чтобы освободить место и продолжить работу без отката.

Видео сокращено и ускорено для наглядности.

Rapidash_Blog_Asset_1x1_V3 on Vimeoplayer.vimeo.com

OpenAI объявила о расширении доступности GPT-5.1-Codex-Max: модель уже работает в Codex для пользователей Plus, Pro, Business, Edu и Enterprise, а вскоре станет доступна и через API-ключ в Codex CLI.

Русскоязычное сообщество про AI в разработке

Друзья! Эту новость подготовила команда ТГК «AI for Devs» — канала, где мы рассказываем про AI-ассистентов, плагины для IDE, делимся практическими кейсами и свежими новостями из мира ИИ. Подписывайтесь, чтобы быть в курсе и ничего не упустить!

Источник: habr.com