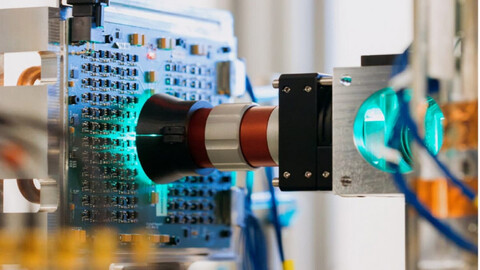

Исследовательская группа Microsoft Research уже четыре года разрабатывает аналоговый оптический компьютер. Авторы проекта используют коммерчески доступные компоненты, такие как сенсоры от камер смартфонов, оптические линзы и микросветодиоды тоньше человеческого волоса.

Вычисления в системе происходят за счёт изменения интенсивности света, проходящего через линзы и сенсоры. Прототип уже демонстрирует энергоэффективность до 500 TOPS на ватт при 8-битной точности, что в 100 раз выше современных GPU.

«Поскольку свет проходит через сенсор с разной интенсивностью, аналоговый оптический компьютер может складывать и умножать числа», — объясняется в блоге Microsoft.

В Microsoft Research предполагают, что технология будет масштабироваться до компьютера, который для решения определённых задач будет в 100 раз быстрее и в 100 раз энергоэффективнее, выполняя задачи ИИ «с затратой лишь доли энергии и на гораздо большей скорости, чем графические процессоры, работающие с современными большими языковыми моделями».

Компания публично поделилась своим алгоритмом «оптимизационного решателя» и разработанным ею «цифровым двойником», чтобы исследователи из других организаций могли поработать с этой вычислительной парадигмой, предлагать новые задачи и способы их решения.

a) Схема аппаратной архитектуры AOC с ключевыми компонентами 1–4. b) Аппаратная архитектура AOC. c) Ключевые аппаратные компоненты. Массив микросветодиодов (1) является источником света. Пространственный модулятор света (2) хранит веса нейронной сети или коэффициенты задачи оптимизации и умножает их на входящий свет. Массив фотодетекторов (3) складывает и передает оптические сигналы в аналоговую электронную область. d) Аппаратное обеспечение AOC используется для ускорения вывода МО с использованием модели равновесия. e) Квадратическая оптимизация как поиск в фиксированной точке. Схема сходимости к минимумам с течением времени для задачи оптимизации с непрерывными (горизонтальные полосы) и бинарными (вертикальные стрелки) переменными, испытывающими градиенты (красный) от других переменных до сходимости к фиксированной точке (зеленый). f) Приложения, реализованные на оборудовании AOC. Оборудование AOC выполняет логический вывод для задач классификации MNIST и Fashion-MNIST, нелинейной регрессии, а также решает задачи промышленной оптимизации, включая реконструкцию медицинских изображений и проведение транзакций между финансовыми учреждениями.

Главный научный руководитель Microsoft Франческа Пармиджани объяснила, что цифровой двойник — это компьютерная модель, имитирующая поведение настоящего аналогового оптического компьютера; он имитирует те же входные данные, процессы и выходные данные, но в цифровой среде — как программная версия аппаратного обеспечения. Это позволило исследователям Microsoft и их коллегам решать задачи оптимизации в масштабе, пригодном для реальных ситуаций. Этот цифровой двойник также позволит другим пользователям экспериментировать с тем, как задачи оптимизации или искусственного интеллекта будут отображаться и запускаться на аппаратном обеспечении аналогового оптического компьютера.

a) Вверху: архитектура нейронной сети, используемая для обучения и вывода. Во время обучения входные данные проецируются в скрытое пространство через слой IP, обрабатываются цифровым двойником оборудования AOC (AOC-DT) и передаются через слой OP. Внизу: процесс вывода на оборудовании AOC: слои IP и OP взаимодействуют с оборудованием, которое обновляет своё начальное состояние s0 до достижения состояния с фиксированной точкой s*. b) Во время вывода изображения MNIST и Fashion-MNIST пропускаются через слой IP и подаются на оборудование AOC. Промежуточные состояния могут проецироваться для отслеживания прогресса, схематически показывая эволюцию от распределения с более высокой энтропией к более низкой. После сходимости нелинейность SoftMax в слое OP выбирает класс с наивысшей вероятностью, тогда как в процессе регрессии слой OP выдаёт непрерывное значение y, при этом среднеквадратическая ошибка (MSE) оценивается относительно истинного значения (GNDTH) для оценки производительности. c) Результаты нелинейной регрессии продемонстрированы для оборудования AOC на гауссовой кривой (слева) и синусоидальной кривой (справа) с потерями MSE 3,75 × 10−3 и 1,21 × 10−2 соответственно. d) Для полных тестовых наборов данных MNIST (слева) и Fashion-MNIST (справа) точность классификации AOC сравнивается с производительностью AOC-DT и модели прямого распространения (FFM). Более высокие точности достигаются для более крупных моделей (4096 весов), которые реализуются с помощью техники временного мультиплексирования. Результаты оборудования согласу��тся с моделированием AOC-DT; Результат аппаратного тестирования с 4096 весами немного превосходит AOC-DT. Пунктирные линии показывают эффективность линейного классификатора; погрешности отражают изменчивость случайного начального значения для AOC-DT и экспериментальных повторов для аппаратного тестирования (методы).

Хитеш Баллани, руководитель исследований будущей инфраструктуры искусственного интеллекта в исследовательской лаборатории Microsoft в Кембридже, заявил, что, по его мнению, AOC может стать переломным моментом. «Мы фактически выполнили твёрдое обещание, что это может существенно повлиять на решение двух реальных задач в двух областях: банковском деле и здравоохранении», — сказал он. По словам исследователя, в компании «открыли совершенно новую область применения, показав, что точно такое же оборудование может использоваться и для моделей ИИ». В примере со здравоохранением, описанном в статье в Nature, авторы разработки использовали цифровой двойник для реконструкции изображений МРТ с высокой степенью точности. Исследование показывает, что устройство теоретически может сократить время, необходимое для выполнения этих сканирований, с 30 минут до пяти. В примере с банковским делом AOC успешно справился со сложным тестом оптимизации.

Теперь исследователи совершенствуют AOC, добавляя всё больше микросветодиодов, при этом размер компьютера будет становиться всё меньше по мере миниатюризации деталей.

Ранее учёные показали прототип «резервуарного» компьютера, который проводит вычисления в ёмкости с водой. Это аналоговый ПК, который способен выполнять ряд задач быстрее и точнее любой цифровой платформы, отмечают создатели. По их словам, поведение волн на воде подчиняется физическим законам и ведёт к прогнозируемому результату. Работа прототипа поддерживается математической моделью, в основу которой включили элементы работы нейронных сетей.

Источник: habr.com