Новая работа исследователей из Google DeepMind отвечает на фундаментальный вопрос в искусственном интеллекте: можно ли создать универсального агента без внутренней модели окружающего мира?

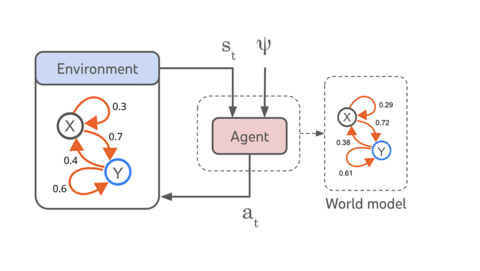

Учёные предложили строгие математические доказательства: любой агент, способный решать многошаговые задачи и обобщать опыт, обязательно выстраивает внутреннюю модель среды, даже если разработчики явно её не закладывали. Более того, точность этой модели прямо определяет возможности системы: чем сложнее цели, тем детальнее должен быть её «внутренний симулятор реальности».

Исследователи показали, что модель мира можно извлечь прямо из политики агента — то есть из его стратегии выбора действий. Они разработали алгоритмы, которые позволяют восстанавливать динамику среды из поведения «чёрного ящика». Это открывает новые перспективы для интерпретируемости и безопасности ИИ: мы можем лучше понимать, какие представления о мире формирует система и как они влияют на её решения.

Практические последствия впечатляют:

Споры о «model-free» и «model-based» подходах теряют смысл. Даже если мы не закладываем модели явно, они появляются неизбежно.

Способности любого ИИ ограничены точностью его внутренней модели. В простых средах её можно выстроить достаточно точно, но в сложных и хаотичных мирах возникают фундаментальные пределы.

Это объясняет, почему у больших языковых моделей проявляются «эмерджентные способности» — они вынуждены строить скрытые модели мира, чтобы справляться с разнообразными задачами.

Работа также ставит важные вопросы о будущем ИИ. Если универсальность всегда упирается в качество модели мира, то создание по-настоящему сильного ИИ неразрывно связано с решением задачи точного моделирования реальности. Это делает направление world models центральным для следующего этапа развития искусственного интеллекта.

Чтобы не пропустить анонс новых материалов подпишитесь на «Голос Технократии» — мы регулярно рассказываем о новостях про AI, LLM и RAG, а также делимся полезными мастридами и актуальными событиями.

Источник: habr.com