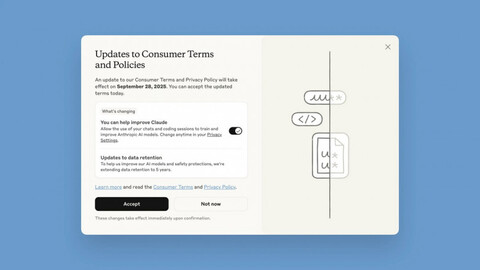

Компания Anthropic вносит существенные изменения в политику обработки пользовательских данных. В соответствии с новыми правилами, пользователи чат-бота на базе искусственного интеллекта Claude должны решить до 28 сентября, хотят ли они разрешить использовать свои данные чатов для обучения моделей Anthropic.

Ранее компания не использовала данные чатов для обучения моделей. Теперь же Anthropic планирует применять для этого разговоры пользователей и сессии программирования. Кроме того, разработчик продлевает срок хранения данных до пяти лет для тех, кто не отказался от этого.

До этого пользователи потребительских продуктов Anthropic получали уведомления о том, что их запросы и данные чатов будут автоматически удалены из бэкэнда компания в течение 30 дней, «если закон и политика не требуют более длительного хранения» или в случаях, когда данные не были помечены как нарушающие правила компании. В этом случае данные пользователя могли храниться до двух лет.

Новая политика будет применяться к пользователям Claude Free, Pro и Max, а также Claude Code. Корпоративных клиентов, использующих Claude Gov, Claude for Work, Claude for Education или доступ через API, обновлённые правила не затронут. OpenAI аналогичным образом защищает корпоративных клиентов от политик обучения моделей на их данных.

Также Anthropic уточняет, что выбор пользователей поможет повысить безопасность моделей, сделав системы обнаружения вредоносного контента более точными и снизив вероятность маркировки безобидных разговоров. Более того, пользователи помогут будущим моделям Claude улучшить навыки программирования, анализа и рассуждений, что должно привести к созданию более качественных решений.

Издание Verge отметило, что многие пользователи Anthropic могут случайно и быстро принять новые правила использования, не прочитав, с чем они соглашаются. Эксперты по конфиденциальности давно предупреждали, что сложность ИИ делает практически невозможным получение осмысленного согласия пользователя.

При администрации президента США Джо Байдена американская Федеральная торговая комиссия предупредила, что компании в сфере ИИ рискуют подвергнуться принудительным мерам, если они будут «скрыто изменять условия обслуживания или политику конфиденциальности, а также скрывать раскрытие информации за гиперссылками, юридическим языком и мелким шрифтом».

Источник: habr.com