Исследователи Microsoft Research представили VibeVoice — модель для генерации диалогов из текста. Главная особенность TTS-системы в том, что она может создавать диалоги продолжительностью до 90 минут с четырьмя действующими лицами.

В основе архитектуры VibeVoice лежит языковая модель Qwen2.5-1.5B. Она анализирует сценарий, удерживает контекст и управляет генерацией. Также в системе есть два токенизатора — акустический и семантический. Важно отметить, что модель поддерживает только английский и китайский.

Архитектура VibeVoice

Также разработчики встроили системы защиты от неправомерного использования VibeVoice. Во-первых, есть слышимый дисклеймер, который предупреждает, что фрагмент сгенерировала нейросеть. Во-вторых, в аудиофайлы встроен скрытый водяной знак. С его помощью также можно узнать, что это продукт нейросети, а не реальная запись.

Для локального запуска исследователи рекомендуют использовать NVIDIA Deep Learning Container. Если нужен интерфейс, то есть инструкция по настройке Gradio. Есть поддержка CLI с возможностью управления спикерами и их голосами.

Модель

Длина контекста

Продолжительность сгенерированного аудио

Веса

VibeVoice-0.5B-Streaming

—

—

Ожидается

VibeVoice-1.5B

64K

~90 min

HF link

VibeVoice-7B

32K

~45 min

HF link (на момент публикации карточка модели пустая)

Разработчики отмечают, что модели можно использовать для исследований. Перед использованием в коммерческих проектах и пользовательских приложениях следует тестировать модель.

Бенчмарки VibeVoice

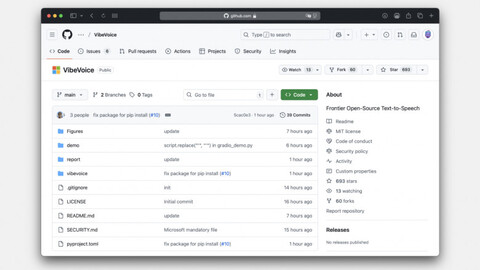

Проект опубликован по лицензии MIT. Дополнительные материалы можно найти на следующих ресурсах:

Код на GitHub: https://github.com/microsoft/VibeVoice.

Бесплатное демо: https://86636c494bbddc69c7.gradio.live/.

Страница проекта: https://microsoft.github.io/VibeVoice/.

Источник: habr.com