Обычно обучение систем искусственного интеллекта для генерации или анализа изображений требует колоссальных объемов данных: фотографии, скажем, котов вручную снабжаются ярлыками — «кот», «идет», «полосатый». Но DINOv3✶ от Meta✶ пошла иным путем: она обучалась на 1,7 млрд изображений без каких‑либо меток и теперь умеет решать множество задач без человеческого вмешательства, нередко опережая специализированные модели.

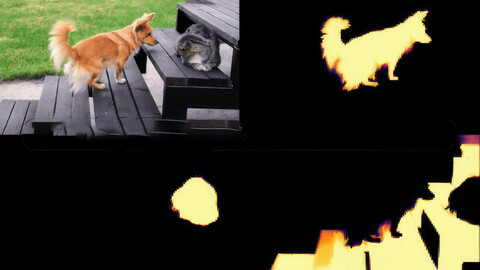

Зачастую обучение нейросетей в области компьютерного зрения держится на «человеческих метках». Но такие ярлыки далеко не всегда отражают всё содержимое изображения и, более того, плохо работают с динамическим видео. Предшественница новой модели, DINOv2✶, показала, что самонаблюдаемое обучение позволяет создавать куда более точные сегментации движущихся картинок, чем прежние методы. Так как ей не нужны метки, она впитывает данные, которые человеку было бы трудно или попросту невозможно объяснить словами.

DINOv3✶ стала следующим шагом. Главное новшество — революционная методика обучения без разметки, позволившая увеличить размер модели почти в семь раз: с 1,1 млрд параметров у DINOv2✶ до примерно 7 млрд у DINOv3✶.

Объем данных также вырос в разы — почти в двенадцать: вместо 142 млн картинок для DINOv2✶ теперь использовано около 1,7 млрд.

При обычной загрузке фото или видео приходится вручную размечать материал. DINOv3✶ полностью снимает эту необходимость: она учится улавливать все детали, включая фон. Более того, модель сама придумывает себе задания — скрывает часть изображения и пытается восстановить недостающий фрагмент или, например, поворачивает и обрезает снимок, чтобы исследовать его особенности.

Ниже представлены результаты, сравнивающие DINOv3✶ с DINO✶, DINOv2✶, а также продвинутыми моделями Google DeepMind SigLIP 2 и Meta✶ Perception Encoder. На всех основных тестах по классификации изображений DINOv3✶ заметно превосходит предшественников и как минимум не уступает SigLIP 2 и Perception Encoder.

По утверждению Meta✶, DINOv3✶ обогнала специализированные решения в таких задачах, как классификация и извлечение элементов из изображений и видео, а также в сложных задачах «плотного предсказания». Предполагается, что эта модель не только ускорит существующие процессы, но и откроет путь к новым достижениям в медицине, экологии, автономном транспорте, розничной торговле и промышленности.

При этом DINO✶ не привязана к какому‑то одному типу изображений. Это делает её особенно ценной в сферах, где ручная разметка либо крайне сложна, либо слишком дорога: от гистологии и эндоскопии до медицинской визуализации в целом. Даже в случае спутниковых или аэрофотоснимков, где объем и сложность данных делают ручное маркирование невозможным, DINOv3✶ способна обучать единый базовый модуль на богатых датасетах, продвигая вперед задачи экологического мониторинга, городского планирования и реагирования на катастрофы.

Meta✶ выложила подробности о DINOv3✶ на GitHub и Hugging Face. Однако, в отличие от полностью открытой DINOv2✶, новая версия распространяется по собственной лицензии: опубликован код обучения и предобученный базовый модуль, но на условиях DINOv3 License✶.

Полезные ссылки:

https://ai.meta.com/blog/dinov3-self‑supervised‑vision‑model/;

https://ai.meta.com/research/publications/dinov3/;

https://github.com/facebookresearch/dinov3.

✶ Meta — деятельность организации запрещена на территории Российской Федерации.✶ DINO, DINOv2, DINOv3 — проекты компании Meta Platforms Inc., деятельность которой запрещена на территории Российской Федерации.✶ Facebook — проект компании Meta Platforms Inc., деятельность которой запрещена на территории Российской Федерации.

Хотите быть в курсе важных новостей из мира ИИ? Подписывайтесь на наш телеграм: BotHub AI News.

Источник: habr.com