Google DeepMind разрабатывает систему, которая обеспечит ИИ-агентов «внутренним голосом», чтобы помочь им более эффективно изучать задачи и в итоге стать «умнее».

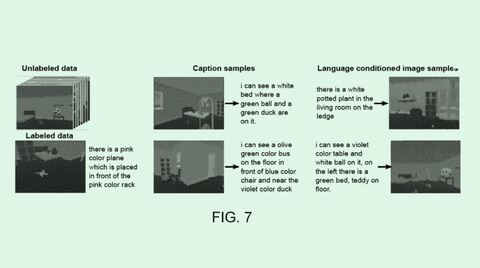

В патентной заявке лаборатория описала метод под названием «Внутриагентная речь для облегчения обучения задачам», где роботы наблюдают за задачами через изображения или видео, а затем генерируют их описания на естественном языке.

По словам исследователей, такой «внутренний монолог» помогает связать визуальный ввод с действиями, позволяя агентам понимать и взаимодействовать с незнакомыми объектами без предварительного обучения, а также снижая требования к памяти и вычислениям.

Например, робот может смотреть видео, на котором кто-то поднимает чашку, одновременно внутренне обрабатывая фразу «человек поднимает чашку». Это позволит агенту «вспоминать» правильные действия, которые следует предпринять при столкновении с похожими объектами. В итоге робот сможет принимать более обоснованные решения и эффективнее адаптироваться к новым ситуациям в динамичных реальных средах.

Техника поддерживает так называемое обучение «с нуля», то есть робот сможет выполнять задачи, связанные с незнакомыми объектами, без предварительного обучения. DeepMind отмечает, что такой подход снизит требования к памяти и вычислительной мощности, необходимым для обучения роботизированных систем.

Инициатива основана на более широких усилиях DeepMind в области робототехники. В июне компания представила «Gemini Robotics On-Device», которая предназначена для работы без доступа к облаку. Google утверждает, что модель компактна и достаточно эффективна, чтобы работать непосредственно внутри робота.

Gemini Robotics On-Device — это версия модели Gemini Robotics Vision-Language, созданная для работы с роботами и без Интернета. Разработанная для чувствительных к задержкам или автономных сред, она работает локально, что позволяет роботам быстро реагировать на меняющиеся условия и сохранять конфиденциальность данных.

Gemini Robotics On-Device способна выполнять задачи из коробки и может адаптироваться к новым всего за 50–100 демонстраций. Разработчики Google позиционируют её как «стартовую модель». Первоначально обученный на роботе ALOHA от Google, ИИ был адаптирован к другим, таким как гуманоид Apollo от Apptronik и Franka FR3. Модель обрабатывает сложные действия, такие как складывание одежды или расстёгивание сумок.

Разработчики могут настраивать модель, дистанционно управляя роботом, чтобы изучать новые задачи. Она поддерживает моделирование с помощью динамики Multi-Joint с физическим движком Contact или развёртывание в физических средах. Однако, в отличие от гибридного аналога, версия на устройстве не имеет встроенных семантических систем безопасности. Google советует разработчикам внедрять собственные протоколы безопасности и на данный момент ограничила доступ к ИИ для оценки реальных рисков безопасности.

Источник: habr.com