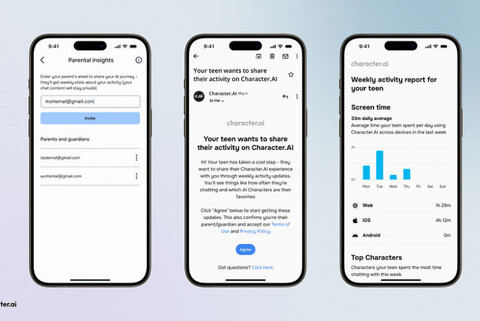

Сервис чат-ботов Character.AI добавляет новую функцию «Родительский контроль», которая позволяет подросткам отправлять еженедельный отчёт об использовании чат-бота на адрес электронной почты родителей.

В соответствии с информацией, представленной в объявлении компании, отчёт содержит данные о среднем времени, которое пользователь проводит в интернете и на мобильных устройствах ежедневно, а также о персонажах, с которыми он чаще всего взаимодействует, и о времени, проведённом в общении с каждым из них. Это часть серии обновлений, призванных решить проблему, связанную с тем, что несовершеннолетние проводят слишком много времени в чат-ботах и сталкиваются с неприемлемым контентом во время общения.

Отчёт, для просмотра которого родителям не нужно иметь учётную запись, является необязательным и может быть настроен несовершеннолетними пользователями в настройках Character.AI.

В компании подчёркивают, что это лишь обзор деятельности подростков, а не исчерпывающая информация. Поэтому содержание бесед с чат-ботом останется конфиденциальным. Платформа не предназначена для детей младше 13 лет в большинстве стран и младше 16 лет в Европе.

С прошлого года Character.AI внедряет новые функции для несовершеннолетних пользователей, что вызывает обеспокоенность — и даже жалобы в суд — по поводу его сервиса. Платформа, популярная среди подростков, позволяет пользователям создавать и настраивать чат-ботов, с которыми они взаимодействуют или которыми делятся публично.

Но в нескольких судебных исках утверждается, что эти боты предлагали непристойный сексуализированный контент или материалы, пропагандирующие членовредительство. Компания также получила предупреждения от Apple и Google (которые наняли Character.AI основатели в прошлом году) о содержимом своего приложения.

Организация утверждает, что с того времени она усовершенствовала свою систему. В частности, она переместила пользователей, не достигших 18 лет, в модель, которая обучена избегать «деликатных» данных. Также были добавлены более заметные предупреждения, которые напоминают пользователям, что боты — это не настоящие люди.

Но с учётом растущего энтузиазма в отношении регулирования ИИ и законов о безопасности детей, это, скорее всего, не последний шаг, который придётся сделать компании.

Источник

Источник: habr.com