OpenAI поделилась системной картой для GPT-4o и выпустила оценочную карту Preparedness Framework, чтобы обеспечить сквозную оценку безопасности модели. Также компания рассказала об ограничениях ИИ и оценках безопасности по нескольким категориям.

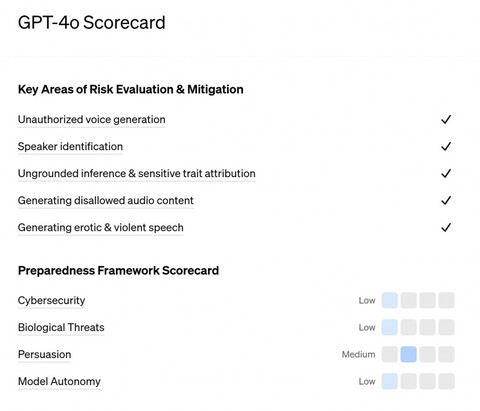

OpenAI провела больше работы по обеспечению безопасности, сосредоточившись на аудиовозможностях GPT-4o. Оцениваемые риски включают идентификацию говорящего, несанкционированную генерацию голоса, потенциальное создание контента, защищённого авторским правом, необоснованные выводы и запрещённый контент. Основываясь на результатах этих оценок, OpenAI внедрила меры безопасности как на уровне модели, так и на уровне системы.

GPT-4o набрала низкие баллы в трёх из четырёх категорий Preparedness Framework, а также средний балл по убедительности. OpenAI отмечает, что можно развёртывать только модели со средней или ниже оценкой.

Компания сотрудничает с более чем 100 внешними участниками «красных команд» для оценки модели перед её выпуском. Они оценят новые потенциальные риски, создаваемые моделью, и проведут стресс-тестирование мер по смягчению последствий.

Команда OpenAI пообещала «отслеживать и обновлять меры по смягчению последствий в соответствии с меняющейся обстановкой».

В мае OpenAI презентовала новую языковую модель GPT-4o. Она может воспринимать и генерировать звук, изображение и текст и доступна всем пользователям бесплатно. С конца июля аудиовозможности модели стали доступными для подписчиков ChatGPT Plus.

В начале августа из OpenAI ушёл ещё один соучредитель и ключевой специалист по безопасности ИИ Джон Шульман. Он объявил, что присоединяется к ИИ-стартапу Anthropic, созданному бывшими исследователями OpenAI.

Источник: habr.com