Новая версия модели ИИ от Google устанавливает новые стандарты скорости, эффективности и безопасности. Доступная в вариантах с 9 и 27 миллиардами параметров, Gemma 2 превосходит свою предшественницу по всем направлениям. Gemma 2 (27B) демонстрирует производительность, сравнимую с запатентованными моделями вдвое большего размера, которые ещё недавно считались эталоном.

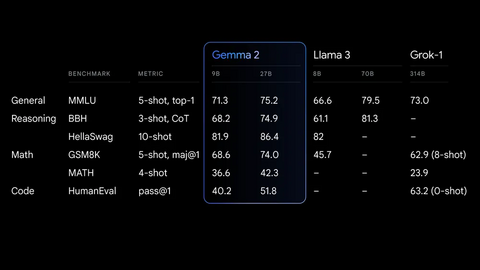

Новая архитектура Gemma 2 обеспечивает оптимальный баланс между производительностью и энергоэффективностью. Версия Gemma 2 (27B) превосходит модели вдвое большего размера в своей весовой категории, а Gemma 2 (9B) показывает выдающиеся результаты, превосходя Llama 3 (8B) и аналогичные модели. Модель совместима с популярными фреймворками, такими как Hugging Face Transformers, JAX, PyTorch и TensorFlow, а также оптимизирована для NVIDIA TensorRT-LLM.

Gemma 2 обучена на массиве данных объемом до 13 триллионов токенов с использованием традиционных методов и дистилляции знаний от более крупных моделей. Важно отметить, что при обучении применялись строгие процедуры безопасности, фильтрация данных и тщательное тестирование на наличие потенциальных рисков.

Протестировать Gemma 2 можно в Google AI Studio (через впн), запустить локально с помощью Gemma.cpp или через Hugging Face Transformers. В ближайшее время клиенты Google Cloud смогут легко развертывать и администрировать Gemma 2 в Vertex AI.

Gemma 2 – это значительный шаг вперед в области ИИ, предоставляющий разработчикам мощный, доступный и простой в использовании инструмент для создания инновационных приложений.

Подробнее можно прочитать тут.

А также прикрепляю отчет.

Источник: habr.com