Исследователи из Иллинойского университета в Урбане-Шампейне сообщают о новом достижении языковой модели GPT-4: она научилась самостоятельно находить и использовать уязвимости нулевого дня, то есть ошибки в системах безопасности, о которых еще никому не известно.

В ходе эксперимента команды ботов, управляемых GPT-4, координировали свои действия, создавали новых ботов по мере необходимости и успешно атаковали более половины тестовых веб-сайтов. Важно отметить, что это не первый случай, когда GPT-4 демонстрирует способности ко взлому. Ранее та же группа исследователей доказала, что модель может использовать уже известные, но неисправленные уязвимости.

Однако обнаружение и использование уязвимостей нулевого дня — задача совершенно иного уровня. Она требует глубокого анализа кода, нестандартного мышления и умения находить неочевидные решения. Для достижения таких результатов исследователи разработали систему HPTSA (Hierarchical Planning and Task-Specific Agents), основанную на иерархическом планировании с использованием ИИ-агентов.

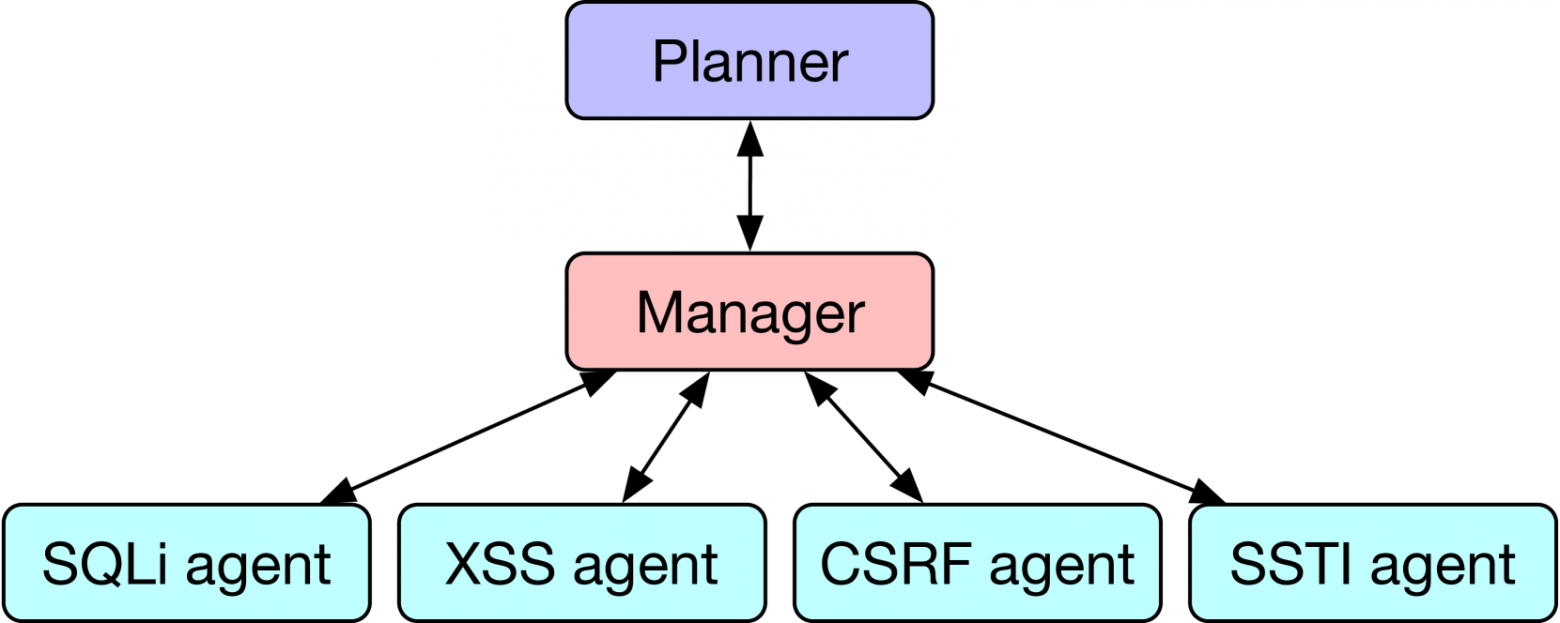

Вместо того чтобы заставлять одну модель решать все задачи, HPTSA использует агента-планировщика. Он анализирует веб-сайт, выявляет потенциальные уязвимости и направляет туда специализированных агентов. Каждый агент обучен на определенном типе уязвимостей и имеет доступ к информации о них, что значительно повышает эффективность системы.

Архитектура HPTSA

Система была протестирована на 15 реальных уязвимостях, которые были неизвестны модели GPT-4, использовавшейся в системе. HPTSA смогла успешно атаковать 53% уязвимостей, в то время как GPT-4 без подробного описания уязвимостей справилась лишь с 12%. HPTSA оказалась в 4.5 раза эффективнее.

Система успешно атаковала уязвимости различных типов, включая XSS, CSRF и SQLi. При этом критически важными факторами успеха стали специализация агентов и доступ к документации по конкретным уязвимостям.

Данное исследование поднимает важные вопросы о будущем кибербезопасности. С одной стороны, злоумышленники получают в свои руки мощный инструмент для проведения автоматизированных атак. С другой стороны, специалисты по безопасности могут использовать подобные системы для более частого и глубокого тестирования на проникновение. Какая из сторон окажется в более выгодном положении — покажет время.

Авторы исследования планируют и дальше совершенствовать HPTSA, повышая ее эффективность и расширяя спектр возможностей. Они также призывают разработчиков LLM уделять особое внимание безопасности своих систем, чтобы предотвратить их использование в злонамеренных целях.

Исследование

Источник: habr.com