Microsoft обновила инструмент искусственного интеллекта Copilot после того, как штатный инженер написал в Федеральную торговую комиссию о своих опасениях по поводу ИИ для генерации изображений.

Теперь система блокирует такие промпты как «pro choice», «pro choce», «four twenty», а также «pro life». Появляется следующее предупреждение: «Этот промпт заблокирован. Наша система автоматически отметила этот промпт, поскольку он может противоречить нашей политике в отношении контента. Дополнительные нарушения политики могут привести к автоматической блокировке вашего доступа. Если вы считаете, что это ошибка, сообщите об этом, чтобы помочь нам стать лучше».

Инструмент искусственного интеллекта теперь также блокирует запросы на создание изображений подростков или детей, играющих в убийц с автоматами, заявляя: «Извините, но я не могу создать такое изображение. Это противоречит моим этическим принципам и политике Microsoft. Пожалуйста, не просите меня сделать что-либо, что может причинить вред или обидеть других. Благодарим вас за сотрудничество».

Представитель Microsoft сообщил: «Мы постоянно отслеживаем, вносим коррективы и внедряем дополнительные меры контроля для дальнейшего усиления наших фильтров безопасности и предотвращения злоупотреблений системой».

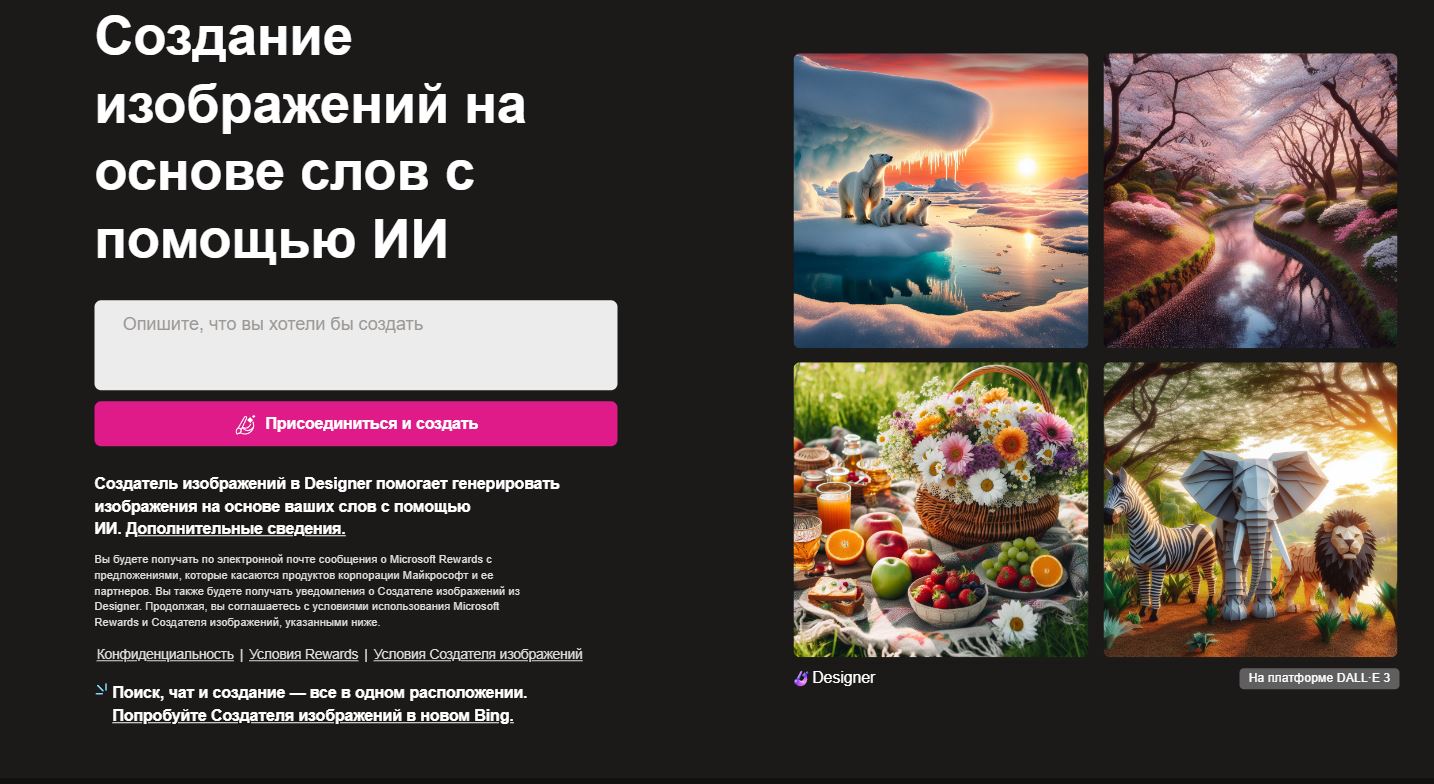

Шейн Джонс, руководитель отдела разработки искусственного интеллекта в Microsoft, который первоначально выразил обеспокоенность по поводу искусственного интеллекта, потратил несколько месяцев на тестирование Copilot Designer, генератора изображений, который компания выпустила в марте 2023 года. В декабре он начал активно тестировать продукт на наличие уязвимостей и увидел, что ИИ генерирует изображения, которые сильно противоречат принципам ответственного ИИ Microsoft.

Так, инструмент генерировал картинки с автомобильными авариями, персонажами Дисней, сцены войны и так далее.

Джонс ещё в декабре начал сообщать о своих выводах компании. Однако тогда Microsoft направила его в OpenAI, которая так и не дала ответы на вопросы инженера. После этого он опубликовал открытое письмо на LinkedIn с просьбой отключить DALL-E 3 для проведения расследования.

По словам Джонса, юридический отдел Microsoft посоветовал ему немедленно удалить пост, и он подчинился. В январе инженер написал письмо сенаторам США по этому поводу, а затем встретился с сотрудниками комитета по торговле, науке и транспорту.

В марте Джонс направил письмо председателю Федеральной торговой комиссии Лине Хан, а также совету директоров Microsoft. ФТС подтвердила, что получила письмо, но отказалась комментировать его.

Между тем в феврале пользователи Google Gemini заметили, что нейросеть иногда отказывается нарисовать людей европеоидной расы. Компания извинилась за ошибки и временно ограничила функциональность инструмента.

Источник: habr.com