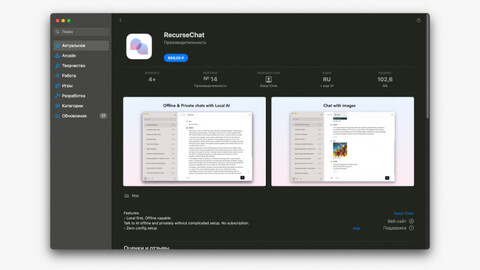

Разработчик Сяои Чэнь (Xiaoyi Chen) выпустил на macOS приложение RecurseChat для локального запуска больших языковых моделей. Интерфейс выполнен в виде чата, а если хочется использовать GPT, то можно подключить модель через API. Приложение платное и доступно в App Store.

RecurseChat работает с открытыми моделями Mistral, Llava и WizardCoder Python и другими в формате GGUF. Главное, чтобы модель поддерживала работу с llama.cpp. Кроме того, пользователи могут использовать GPT-3 и GPT-4. Для этого необходимо подключить модель с помощью собственного API-ключа.

Благодаря локальному запуску приложение может работать без подключения к сети, отвечая на вопросы, генерируя код и контент. В настройках RecurseChat можно настраивать ИИ-агентов: задать имя, описать задачи бота и указать параметры модели. Есть возможность импортировать историю чатов из ChatGPT и продолжить общение с нейросетью уже в RecurseChat.

Приложение работает на Mac с чипами Apple Silicon и под управлением macOS Ventura 13.5 или более новых. RecurseChat можно приобрести в App Store за 10 долларов, а в российской версии — за 900 рублей.

Источник: habr.com