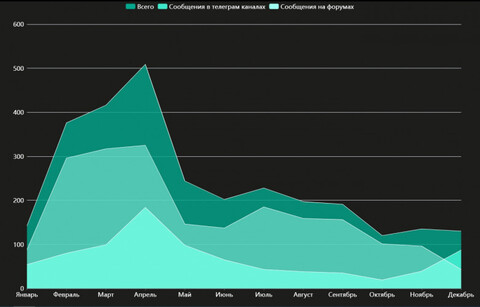

Специалисты Kaspersky Digital Footprint Intelligence (DFI) опубликовали результаты исследования того, как в даркнете обсуждается использование чат-ботов для кибератак. В 2023 году было обнаружено 2890 таких сообщений, с пиком в более 500 сообщений в апреле.

Использовать чат-боты с искусственным интеллектом злоумышленники предлагают разными способами. В частности, для генерации полиморфного вредоносного кода — ВПО, которое способно менять свой код, сохраняя базовый функционал.

«Обнаружение и анализ подобных программ значительно сложнее, чем в случае с обычными зловредами. Автор сообщения предлагает использовать API OpenAI для генерации кода с заданным функционалом. Таким образом с помощью обращения к легитимному домену (openai.com) из инфицированного объекта злоумышленник может сгенерировать и запустить вредоносный код, обходя ряд стандартных проверок безопасности. На данный момент мы не обнаружили вредоносные программы, действующие таким образом, однако они вполне могут появиться в будущем», — пишут в Kaspersky Digital Footprint Intelligence.

Чтобы заставить модель генерировать ответы, связанные с противозаконной деятельностью, злоумышленники придумывают наборы команд (jailbreak), которые активно распространяются и дорабатываются участниками даркнет-форумов. Всего за 2023 год было замечено 249 предложений как по распространению, так и по продаже подобных подобранных команд.

Также, как отмечают Kaspersky Digital Footprint Intelligence, киберпреступники активно берут на вооружение open source-проекты, которые создаются для специалистов по информационной безопасности.

«Одна из утилит с открытым исходным кодом, размещённая на платформе GitHub, предназначена для обфускации кода, написанного на PowerShell. Подобное часто используется как специалистами по кибербезопасности, так и злоумышленниками во время проникновения в систему и попытке закрепления в ней. Обфускация позволяет повысить шанс остаться незамеченным со стороны систем мониторинга и антивирусных решений. С помощью сервиса Kaspersky Digital Footprint Intelligence был обнаружен пост на киберпреступном форуме, в котором злоумышленники делятся этой утилитой, показывают, как её можно использовать для вредоносных целей и какой результат это даст».

Внимание киберпреступников также привлекают такие проекты, как WormGPT, XXXGPT, FraudGPT и прочие. Это языковые модели, рекламируемые как замена ChatGPT с отсутствующими ограничениями оригинала и дополнительным функционалом.

Специалисты отмечают, что приведённые ими примеры не предполагают, что чат-боты и другие инструменты опасны сами по себе, но помогают понять, как злоумышленники могут использовать их в неправомерных целях.

«Подводя итоги, скажем, что тренд на популярность использования ИИ злоумышленниками вызывает тревогу. Информация становится более доступной, многие проблемы решаются с помощью одного запроса. Всё это позволяет упрощать жизнь людям, но одновременно с этим снижает порог входа для различных мошенников. Пусть сейчас многие рассмотренные решения не представляют реальной угрозы ввиду их бесхитростности, тем не менее технологии развиваются стремительными темпами, и вполне вероятно, что вскоре возможности языковых моделей позволят осуществлять сложные атаки», — заключают специалисты.

Источник: habr.com